Sejarah Perkembangan Komputer itu bukan cuma deretan tahun dan nama mesin yang membosankan. Bayangkan, perjalanan panjang ini dimulai dari manik-manik kayu yang digesak-gesak sampai ke prosesor sekecil kuku yang bisa menghubungkan kita dengan seluruh dunia. Narasi ini adalah tentang kecerdikan manusia yang tak pernah puas, tentang bagaimana kita berusaha menciptakan ‘otak’ bantuannya sendiri, bertransformasi dari alat hitung mekanis yang kluntang-kluntung menjadi entitas digital yang nyaris menjadi perpanjangan diri kita.

Dari konsep visioner Charles Babbage dan Ada Lovelace di era Victoria, melalui revolusi transistor yang mengecilkan seluruh ruangan menjadi sebuah kotak di meja, hingga ledakan PC yang mendemokratisasikan akses informasi, setiap babak menyisakan lompatan teknologi yang mendefinisikan ulang peradaban. Tulisan ini akan menelusuri tapak-tapak besar itu, mengurai bagaimana komponen, arsitektur, dan perangkat lunak berevolusi bersama, membawa kita dari era komputasi yang sentralistik dan eksklusif menuju realitas saat ini di mana komputasi ada di mana-mana, tersebar, dan personal.

Asal-usul dan Konsep Awal

Source: slidesharecdn.com

Sebelum kata “komputer” merujuk pada mesin elektronik, ia adalah sebutan untuk orang yang melakukan perhitungan. Perjalanan menuju mesin komputasi otomatis dimulai jauh di masa lalu, dengan alat bantu hitung mekanis yang merevolusi cara manusia berinteraksi dengan angka. Narasi ini bukan hanya tentang roda gigi dan tuas, tetapi juga tentang mimpi untuk mendelegasikan proses berpikir yang rumit kepada sebuah mesin.

Dari sempoa yang telah digunakan sejak ribuan tahun sebelum Masehi, hingga mesin-mesin rumit abad ke-17 dan 18, setiap inovasi membawa kita selangkah lebih dekat. Titik balik yang sesungguhnya terjadi ketika konsep “program” mulai muncul, mengubah alat hitung dari mesin yang dikhususkan untuk satu tugas menjadi entitas yang dapat diinstruksikan untuk melakukan berbagai operasi.

Alat Hitung Mekanis Pra-Abad ke-20

Peradaban kuno telah mengembangkan alat untuk mempermudah perhitungan, dengan sempoa sebagai contoh paling tangguh yang masih digunakan di beberapa tempat hingga kini. Namun, lompatan signifikan terjadi di era Renaisans dan Pencerahan. John Napier menciptakan “Napier’s Bones”, sebuah alat berbasis batang yang mempermudah perkalian dan pembagian. Blaise Pascal, pada 1642, merancang Pascaline, kalkulator mekanis pertama yang bisa melakukan penjumlahan dan pengurangan secara langsung melalui putaran roda.

Kemudian, slide rule menjadi teman setia insinyur dan ilmuwan selama berabad-abad untuk kalkulasi matematis yang kompleks. Tabel berikut membandingkan karakteristik beberapa alat hitung kunci tersebut.

| Alat | Periode | Prinsip Kerja | Fungsi Utama |

|---|---|---|---|

| Sempoa | Sejak ~2700 SM | Manipulasi manik-manik pada batang | Penjumlahan, Pengurangan |

| Napier’s Bones | 1617 | Batang bertuliskan tabel perkalian | Perkalian, Pembagian, Akar |

| Pascaline | 1642 | Roda bergigi yang saling terkait | Penjumlahan, Pengurangan |

| Slide Rule | Abad ke-17 | Skala logaritma yang dapat digeser | Perkalian, Pembagian, Fungsi Trigonometri & Eksponensial |

Konsep Pemrograman dan Analytical Engine

Di tengah mesin uap dan revolusi industri, Charles Babbage, seorang matematikawan Inggris, membayangkan mesin yang jauh melampaui kalkulator. Analytical Engine-nya, yang dirancang sekitar 1837, adalah cetak biru pertama untuk komputer tujuan umum yang dapat diprogram. Mesin ini memiliki arsitektur yang menakjubkan modern: sebuah “Mill” (Unit Pemrosesan/Pengolah), sebuah “Store” (Memori), input melalui kartu plong yang diadaptasi dari alat tenun Jacquard, dan output berupa printer atau pelubang kartu.

Bayangkan sebuah mesin sebesar ruangan, dengan ratusan roda gigi dan poros yang berputar. Kartu plong berisi urutan instruksi akan dibaca oleh pembaca kartu, mengatur kondisi mesin. Data angka akan disimpan dalam kolom roda gigi di bagian “Store”. Instruksi akan membawa data dari Store ke Mill untuk dihitung (tambah, kurang, kali, bagi), dan hasilnya dikembalikan ke Store atau dicetak. Inilah mesin yang sepenuhnya mekanis, namun konsepnya adalah fondasi komputasi digital.

Yang lebih luar biasa lagi, Ada Lovelace, kolega Babbage, melihat potensi yang bahkan melampaui visi penciptanya. Dalam catatannya yang mendalam tentang mesin tersebut, Lovelace menjelaskan algoritma untuk menghitung deret bilangan Bernoulli menggunakan Analytical Engine. Algoritma inilah yang dianggap sebagai program komputer pertama di dunia. Lovelace juga berspekulasi bahwa mesin suatu hari nanti mungkin bisa menciptakan musik atau seni, sebuah pandangan visioner tentang kemampuan komputer di luar sekadar angka.

Generasi Komputer dan Perkembangan Teknologi

Setelah konsep dasar terbentuk, evolusi komputer kemudian bergerak dalam lompatan-lompatan besar yang sering dikategorikan ke dalam “generasi”. Setiap generasi ditandai oleh teknologi komponen utama yang berbeda, yang secara radikal mengubah ukuran, kecepatan, biaya, dan aksesibilitas komputer. Pergeseran ini bukan hanya sekadar penyempurnaan, melainkan revolusi yang berulang kali mendefinisikan ulang apa yang mungkin dilakukan oleh mesin ini.

Transisi dari tabung vakum yang rapuh dan boros energi ke transistor yang kecil dan andal, kemudian ke sirkuit terintegrasi yang memadatkan ribuan transistor dalam satu chip, adalah kisah tentang miniaturisasi dan efisiensi yang spektakuler. Perkembangan paralel dalam memori dan penyimpanan memungkinkan data disimpan lebih banyak dan diakses lebih cepat, membuka jalan bagi perangkat lunak yang semakin kompleks.

Ciri dan Teknologi Tiap Generasi, Sejarah Perkembangan Komputer

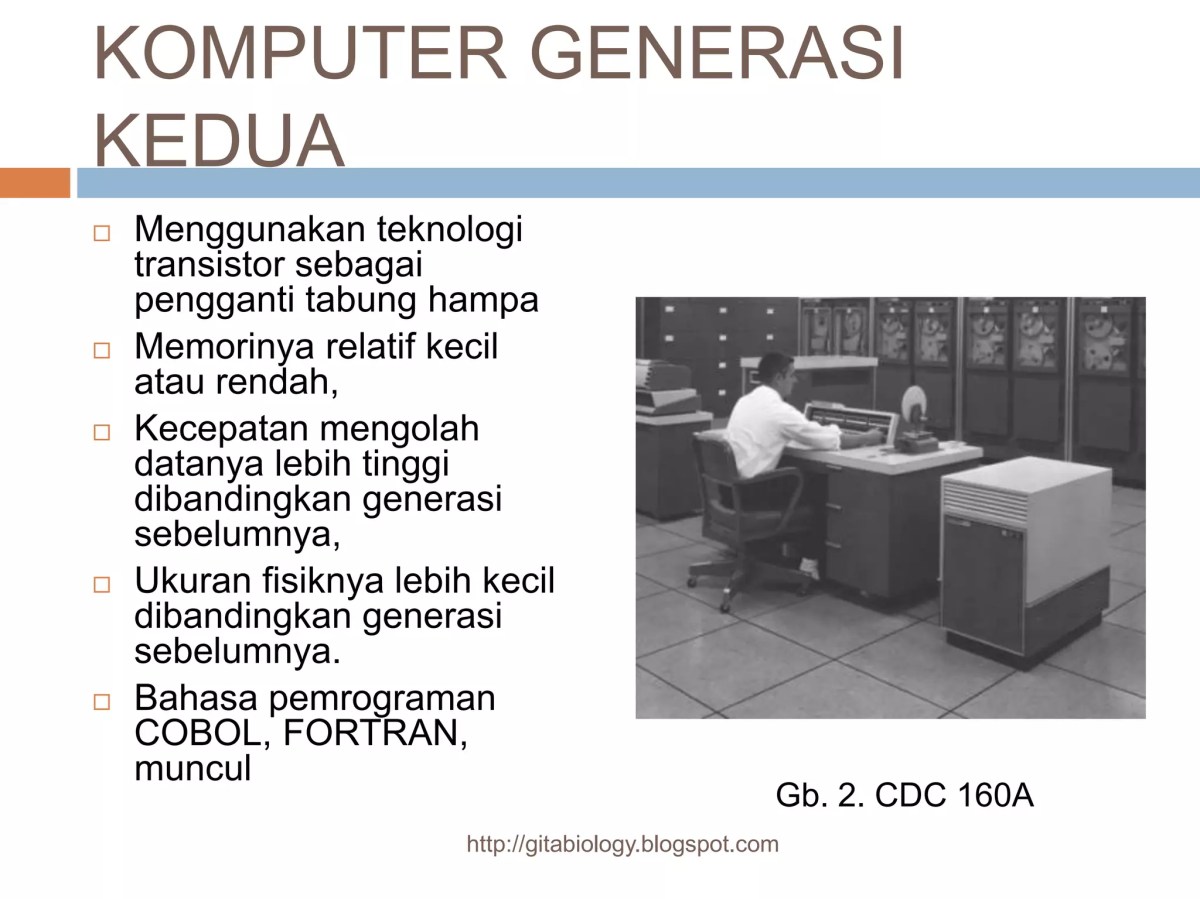

Komputer generasi pertama (1940-an-1950-an) dikuasai oleh tabung vakum, komponen besar yang mudah panas dan rentan rusak. Mereka mengisi seluruh ruangan, membutuhkan daya listrik yang sangat besar, dan diprogram langsung dalam bahasa mesin. Generasi kedua (akhir 1950-an-1960-an) menyambut penemuan transistor, yang lebih kecil, lebih hemat daya, dan lebih dapat diandalkan. Komputer menjadi lebih cepat dan mulai menggunakan bahasa pemrograman tingkat tinggi seperti FORTRAN dan COBOL.

Generasi ketiga (1960-an-1970-an) diperkenalkan oleh sirkuit terintegrasi (IC), yang menggabungkan banyak transistor dalam satu chip silikon kecil. Ini memungkinkan peningkatan kecepatan dan keandalan yang drastis, serta lahirnya sistem operasi yang memungkinkan multitasking. Generasi keempat (1970-an-sekarang) dimulai dengan mikroprosesor, sebuah CPU utuh dalam satu chip. Inilah era yang memicu revolusi komputer pribadi. Perkembangan memori dan penyimpanan mengikuti jejak ini, seperti terlihat pada tabel berikut.

| Generasi | Teknologi Memori | Kapasitas Khas | Media Penyimpanan Utama |

|---|---|---|---|

| Pertama | Delay Line Memory, Magnetic Core | Beberapa kilobyte | Kartu Plong, Pita Magnetik |

| Kedua | Magnetic Core Memory | Puluhan hingga ratusan kilobyte | Pita Magnetik, Disk Pack Magnetik Awal |

| Ketiga | Semiconductor Memory (RAM), Magnetic Core | Ratusan kilobyte hingga beberapa megabyte | Disk Magnetik (Hard Disk), Floppy Disk |

| Keempat | Dynamic RAM (DRAM), Static RAM (SRAM) | Megabyte hingga gigabyte (dan seterusnya) | Hard Disk Drive (HDD), Solid State Drive (SSD), Optical Disc |

Dampak Transistor dan Kemajuan Bahasa Pemrograman

Penemuan transistor pada 1947 di Bell Labs adalah titik kritis. Dengan menggantikan tabung vakum, transistor secara langsung memicu miniaturisasi. Komputer yang sebelumnya sebesar lemari es atau mobil bisa menyusut menjadi seukuran lemari pakaian, lalu menjadi lebih kecil lagi. Konsumsi daya turun drastis, panas yang dihasilkan berkurang, dan keandalan meningkat pesat. Transistor adalah batu bata fundamental yang memungkinkan segala perkembangan sirkuit terintegrasi dan mikroprosesor setelahnya.

Perkembangan perangkat keras berjalan beriringan dengan evolusi bahasa untuk berkomunikasi dengan mesin. Berikut adalah kemajuan signifikan dalam bahasa pemrograman di tiap generasi:

- Generasi Pertama: Bahasa Mesin – instruksi biner (0 dan 1) yang langsung dimengerti CPU.

- Generasi Kedua: Bahasa Assembly – menggunakan singkatan mnemonik (seperti ADD, MOV) sebagai representasi simbolis dari kode mesin.

- Generasi Ketiga: Bahasa Tingkat Tinggi seperti FORTRAN (untuk sains), COBOL (untuk bisnis), dan C. Mereka menggunakan sintaks mirip bahasa manusia dan membutuhkan compiler.

- Generasi Keempat: Bahasa yang lebih spesialis dan produktif seperti SQL (untuk database), Python, dan JavaScript, yang memfokuskan pada “apa” yang ingin dicapai daripada “bagaimana” cara mesin melakukannya.

Inovasi Perangkat Keras yang Mengubah Paradigma

Di balik kategori generasi, terdapat momen-momen eureka spesifik dalam desain perangkat keras yang secara fundamental mengubah arah komputasi. Inovasi-inovasi ini tidak hanya membuat komputer lebih cepat atau lebih kecil, tetapi mengubah cara kita berpikir tentang struktur dan fungsi mesin itu sendiri. Mereka adalah solusi elegan untuk masalah yang membatasi, membuka pintu bagi arsitektur yang masih kita gunakan hingga hari ini.

Dari cara program disimpan dan dijalankan, hingga cara kita berinteraksi dengan layar, setiap lompatan ini membuat komputer menjadi lebih “pintar” di satu sisi, dan lebih “mengerti” manusia di sisi lain. Evolusi ini menunjukkan bahwa kemajuan komputasi adalah cerita tentang abstraksi—menyembunyikan kompleksitas mesin sehingga pengguna dapat fokus pada masalah yang ingin dipecahkan.

Arsitektur ENIAC dan EDVAC

ENIAC, yang sering disebut komputer elektronik pertama yang dapat diprogram ulang, adalah raksasa yang diatur melalui kabel dan sakelar. Untuk memprogramnya, teknisi harus secara fisik mengubah koneksi kabel dan mengatur ribuan sakelar, sebuah proses yang bisa memakan waktu berhari-hari. Programnya secara efektif “terdapat” dalam pengkabelan fisiknya. EDVAC, yang dirancang setelahnya, memperkenalkan konsep revolusioner: Program Stored (Program Tersimpan).

Dalam arsitektur EDVAC, instruksi program disimpan dalam memori yang sama dengan data, sebagai angka biner. Ini memungkinkan CPU untuk mengambil instruksi dengan kecepatan elektronik, mengubahnya dengan cepat, dan bahkan memodifikasi program itu sendiri selama eksekusi. Konsep ini, yang sering dikaitkan dengan John von Neumann, menjadi fondasi bagi hampir semua komputer modern, sehingga dikenal sebagai “Arsitektur Von Neumann”.

“Konsep ‘program stored’ adalah prinsip pengorganisasian sentral yang memisahkan komputer modern dari sekadar kalkulator yang dapat dikonfigurasi. Ini mengubah instruksi menjadi data yang dapat dimanipulasi, memberikan fleksibilitas tak terbatas dan memungkinkan perkembangan perangkat lunak sebagai disiplin independen.” – Esensi dari laporan First Draft of a Report on the EDVAC oleh John von Neumann.

Evolusi Antarmuka Pengguna dan CPU

Interaksi manusia-komputer berevolusi dari yang sangat abstrak menjadi semakin intuitif. Dimulai dengan kartu plong dan pita kertas, kemudian terminal berbasis teks dengan keyboard, di mana perintah harus diketik dengan sintaks yang tepat. Revolusi besar berikutnya adalah mouse dan Graphical User Interface (GUI), yang dipopulerkan oleh Xerox Alto dan kemudian Apple Macintosh. GUI menggunakan metafora desktop dengan ikon, jendela, dan menu yang dapat diklik, membuat komputer dapat diakses oleh khalayak non-teknis.

Di sisi pemrosesan, Central Processing Unit (CPU) mengalami transformasi paralel. Awalnya berupa rak-rak papan sirkuit dengan banyak chip terpisah. Mikroprosesor mengkonsolidasikan ini menjadi satu chip. Kemudian, untuk mengatasi batasan kecepatan clock, desain beralih ke prosesor multi-core. Alih-alih membuat satu core yang berjalan lebih cepat (yang menghasilkan panas berlebihan), produsen menempatkan dua, empat, atau bahkan puluhan core independen dalam satu chip.

Ini memungkinkan pemrosesan paralel yang sejati, sangat meningkatkan kinerja untuk tugas-tugas seperti rendering video, simulasi, dan menjalankan banyak aplikasi sekaligus.

Revolusi Personal Computer (PC) dan Komputasi Modern

Jika generasi sebelumnya mendominasi ruangan ber-AC di perusahaan dan universitas, maka revolusi sesungguhnya terjadi ketika komputer menemukan jalannya ke rumah dan meja kerja biasa. Era Personal Computer (PC) mengubah komputer dari alat institusional yang mahal menjadi alat produktivitas, kreativitas, dan hibuan yang personal. Perubahan ini didorong oleh persaingan dan kolaborasi segitiga antara raksasa perangkat keras, pembuat sistem operasi, dan pengembang perangkat lunak aplikasi.

Revolusi PC juga tidak bisa dipisahkan dari dua fenomena pendamping: jaringan dan internet. Komputer yang tadinya berdiri sendiri mulai terhubung, pertama dalam jaringan lokal (LAN), kemudian dalam jaringan global. Konektivitas ini mengubah fungsi komputer dari mesin penghitung yang canggih menjadi portal menuju informasi dan komunikasi dunia, mendefinisikan ulang makna “komputasi” itu sendiri.

Peran IBM, Apple, dan Microsoft

IBM, dengan PC 5150-nya yang dirilis pada 1981, memberikan legitimasi dan standar arsitektur terbuka (berbasis prosesor Intel dan sistem operasi DOS) yang mendorong industri “kloning”. Apple, di sisi lain, sejak awal bersikukuh pada pendekatan terintegrasi antara perangkat keras dan lunak, dengan fokus kuat pada pengalaman pengguna yang intuitif melalui Macintosh. Microsoft, dengan sistem operasi MS-DOS dan kemudian Windows, menjadi penyedia platform perangkat lunak yang mendominasi, memisahkan perangkat lunak dari perangkat keras tertentu dan menciptakan ekosistem aplikasi yang luas.

Tabel berikut memetakan spesifikasi beberapa PC ikonis di era awal.

| Model PC | Tahun | Prosesor | Memori (RAM) | Fitur Pembeda |

|---|---|---|---|---|

| IBM PC 5150 | 1981 | Intel 8088 @ 4.77 MHz | 16 KB – 256 KB | Arsitektur terbuka, menjadi standar industri, menggunakan MS-DOS. |

| Apple Macintosh 128K | 1984 | Motorola 68000 @ 8 MHz | 128 KB | GUI berbasis mouse pertama yang sukses secara komersial, semua-dalam-satu. |

| Commodore 64 | 1982 | MOS Technology 6510 @ 1 MHz | 64 KB | Komputer rumah paling laris sepanjang masa, grafis & suara yang kuat untuk gaming. |

Transisi ke Komputasi Terdistribusi dan Pengaruh Internet

Model komputasi terpusat, di mana banyak terminal “bodoh” mengakses satu mainframe yang kuat, secara bertahap digantikan oleh komputasi terdistribusi. Setiap PC adalah entitas yang mandiri, tetapi dapat terhubung ke server untuk berbagi sumber daya seperti file, printer, atau koneksi internet. Jaringan Local Area Network (LAN) menjadi standar di kantor dan kampus.

Perkembangan komputer dari mesin raksasa hingga perangkat genggam kita hari ini bukan cuma soal transistor yang mengecil. Evolusi teknologi ini sebenarnya punya pola mirip dengan ekosistem, di mana setiap inovasi saling terhubung dan beradaptasi. Nah, berbicara adaptasi, pendekatan holistik seperti yang dijelaskan dalam Pemanfaatan Ilmu Ekologi untuk Atasi Permasalahan Manusia dan Lingkungan bisa jadi lensa menarik. Dengan prinsip keseimbangan dan keberlanjutan ala ekologi, kita bisa mendesain sejarah komputer selanjutnya yang lebih ramah dan selaras dengan lingkungan, bukan sekadar mengejar kecepatan semata.

Namun, pengaruh terbesar datang dari internet. Awalnya proyek pemerintah dan akademik, internet yang dikombinasikan dengan World Wide Web mengubah komputer dari alat komputasi menjadi alat komunikasi dan pencarian informasi global. Fungsi-fungsi baru seperti email, browsing web, e-commerce, dan media sosial menjadi utama. Komputer menjadi titik akses ke dunia digital yang terus berkembang, mempercepat globalisasi dan menciptakan bentuk-bentuk interaksi sosial serta ekonomi yang sama sekali baru.

Dari mesin hitung mekanik abad ke-19 hingga superkomputer quantum hari ini, sejarah perkembangan komputer adalah narasi eksponensial. Evolusi ini, ironisnya, baru terasa dampak massalnya ketika hardware raksasa itu menyusut jadi chip di genggaman kita, memungkinkan Kemudahan yang Diperoleh dari Kemajuan Sistem Informasi dan Komunikasi yang kini jadi napas keseharian. Jadi, menelusuri jejak ENIAC atau transistor bukan sekadar nostalgia, melainkan memahami fondasi digital yang mengubah cara kita hidup, bekerja, dan bersosialisasi secara fundamental.

Arah dan Tren Masa Depan

Setelah melalui evolusi dari mesin mekanis sebesar ruangan menjadi perangkat yang pas di saku, pertanyaannya kini adalah: ke mana arah komputasi selanjutnya? Batas-batas fisik transistor silikon konvensional mulai terlihat, mendorong pencarian paradigma komputasi baru yang radikal. Masa depan komputasi tidak lagi hanya tentang membuat transistor yang lebih kecil, tetapi tentang mengeksplorasi prinsip-prinsip fisika kuantum, meniru efisiensi otak biologis, dan menciptakan kecerdasan yang tertanam di segala tempat.

Tren ini mengindikasikan pergeseran dari komputasi yang hanya melakukan perintah, menuju sistem yang mampu belajar, beradaptasi, dan bahkan memecahkan masalah yang saat ini dianggap tidak mungkin bagi komputer klasik. Ini adalah babak baru di mana batas antara perangkat keras, perangkat lunak, dan kecerdasan buatan menjadi semakin kabur.

Komputasi Kuantum dan Biologis

Komputasi kuantum memanfaatkan prinsip superposisi dan keterkaitan (entanglement) dari mekanika kuantum. Sementara bit klasik hanya bernilai 0 atau 1, qubit (quantum bit) dapat berada dalam keadaan 0, 1, atau keduanya secara bersamaan (superposisi). Ini memungkinkan komputer kuantum untuk mengeksplorasi sejumlah besar kemungkinan solusi secara paralel. Potensi disruptifnya sangat besar untuk bidang seperti kriptografi (memecahkan kode), penemuan obat (simulasi molekul kompleks), dan optimisasi logistik, di mana masalahnya terlalu rumit untuk komputer klasik sekalipun.

Di jalur lain, komputasi biologis dan neuromorfik mencari inspirasi dari sistem saraf. Komputasi neuromorfik merancang chip hardware yang meniru struktur neuron dan sinapsis otak, bertujuan untuk mencapai efisiensi energi dan kemampuan pembelajaran yang mirai otak untuk tugas-tugas seperti pengenalan pola dan sensorik. Sementara komputasi biologis yang lebih eksperimental mengeksplorasi penggunaan molekul DNA atau protein sebagai medium komputasi.

Peran AI dalam Pengembangan Perangkat Keras Baru

Kecerdasan Buatan (AI) tidak hanya berjalan di atas perangkat keras yang ada, tetapi kini juga mendorong desain perangkat keras baru yang khusus untuknya. Contoh penerapannya meliputi:

- Processing Unit Khusus: Chip seperti Tensor Processing Unit (TPU) dari Google atau Neural Processing Unit (NPU) di smartphone, yang dioptimalkan khusus untuk operasi aljabar linear yang mendasari jaringan saraf, jauh lebih efisien daripada CPU umum.

- Desain Otomatis dengan AI: Algoritma AI digunakan untuk mengeksplorasi ruang desain chip yang sangat besar, membantu insinyur menata letak komponen pada chip (floorplanning) dengan lebih optimal untuk kinerja dan efisiensi daya.

- Perangkat Keras yang Dapat Beradaptasi: Penelitian pada FPGA (Field-Programmable Gate Array) dan arsitektur yang dapat dikonfigurasi ulang secara dinamis, yang dapat mengubah sirkuit internalnya untuk mengakselerasi algoritma tertentu yang sedang dijalankan.

Ilustrasi Komputer Wearable Masa Depan

Bayangkan sebuah perangkat wearable canggih di masa depan, bukan sekadar smartwatch atau kacamata AR saat ini. Bentuk faktornya adalah sebuah gelang atau sarung tangan yang sangat tipis dan fleksibel, terbuat dari bahan biomaterial yang nyaman dikenakan sepanjang hari. Antarmukanya adalah campuran antara proyeksi holografik rendah di bidang pandang pengguna (yang hanya terlihat oleh pemakainya) dan umpan balik haptik yang canggih pada kulit untuk memberikan sensasi sentuhan.

Perangkat ini berfungsi sebagai pusat komputasi personal yang selalu menyertai. Ia akan memproses data kesehatan secara real-time, berinteraksi dengan lingkungan cerdas (smart home, smart city), dan menjadi asisten AI yang kontekstual. Input utama bukan lagi ketikan atau klik, tetapi gestur halus, perintah suara alami, dan bahkan interpretasi dari sinyal saraf (melalui antarmuka saraf non-invasif). Komputasinya didistribusikan: tugas berat didelegasikan ke cloud atau perangkat edge terdekat, sementara tugas yang membutuhkan respons segera dan privasi tinggi diproses secara lokal oleh chip neuromorfik hemat daya di dalam wearable itu sendiri.

Terakhir

Jadi, begitulah secuil kisahnya. Dari sempoa yang mengandalkan otot jari hingga komputer kuantum yang bermain dengan probabilitas partikel subatom, sejarah perkembangan komputer pada hakikatnya adalah sejarah pemampatan kompleksitas. Kita menyaksikan bagaimana mesin yang awalnya hanya dirancang untuk mengotomatisasi perhitungan aritmatika, berkembang menjadi platform untuk seni, komunikasi, dan bahkan eksplorasi kesadaran buatan. Perjalanan ini tidak linier, tetapi penuh dengan lompatan-lompatan liar yang didorong oleh perang, bisnis, dan tentu saja, rasa ingin tahu manusia yang tak terobati.

Melihat ke depan, garis antara alat dan pengguna kian kabur. Komputer tidak lagi sekadar benda yang kita

-gunakan*, tetapi menjadi lingkungan yang kita

-huni*. Tantangan etis dan filosofis yang muncul mungkin lebih kompleks daripada tantangan teknisnya sendiri. Namun, satu hal yang pasti: roda inovasi ini tidak akan berhenti berputar. Setiap akhir dari sebuah generasi komputer hanyalah pembuka bagi babak baru yang lebih mencengangkan, membuktikan bahwa sejarah paling menarik dari mesin cerdas ini mungkin justru sedang kita tulis bersama di detik ini.

Panduan FAQ: Sejarah Perkembangan Komputer

Apakah komputer pertama benar-benar sebesar satu ruangan?

Ya, komputer generasi pertama seperti ENIAC (1945) memang sangat besar, beratnya mencapai 27 ton dan memenuhi ruangan seluas 167 meter persegi, namun ia jauh kurang bertenaga dibanding ponsel pintar masa kini.

Mengapa mouse disebut ‘mouse’ (tikus)?

Nama tersebut diberikan oleh penemunya, Douglas Engelbart, karena kabel yang terhubung di belakang perangkatnya menyerupai ekor tikus. Nama itu terbawa dan menjadi istilah standar hingga sekarang.

Adakah komputer yang gagal total secara komersial tetapi penting secara historis?

Banyak. Contohnya adalah Mesin Differensi Babbage atau komputer LISA dari Apple. Meski tidak sukses di pasaran, mereka memperkenalkan konsep revolusioner (pemrograman dan GUI) yang menjadi fondasi bagi produk-produk sukses berikutnya.

Bagaimana perkembangan game memengaruhi sejarah komputer?

Permintaan akan grafis dan pemrosesan yang lebih baik untuk game mendorong inovasi besar di kartu grafis (GPU) dan prosesor. GPU awalnya untuk rendering game, kini menjadi inti komputasi untuk AI dan penelitian ilmiah.

Apa hubungan perkembangan komputer dengan lingkungan?

Dampaknya besar. Miniaturisasi menghemat material fisik, tetapi ledakan jumlah perangkat dan pusat data justru meningkatkan konsumsi energi global. Tren kini berfokus pada efisiensi energi, daur ulang komponen, dan komputasi hijau.